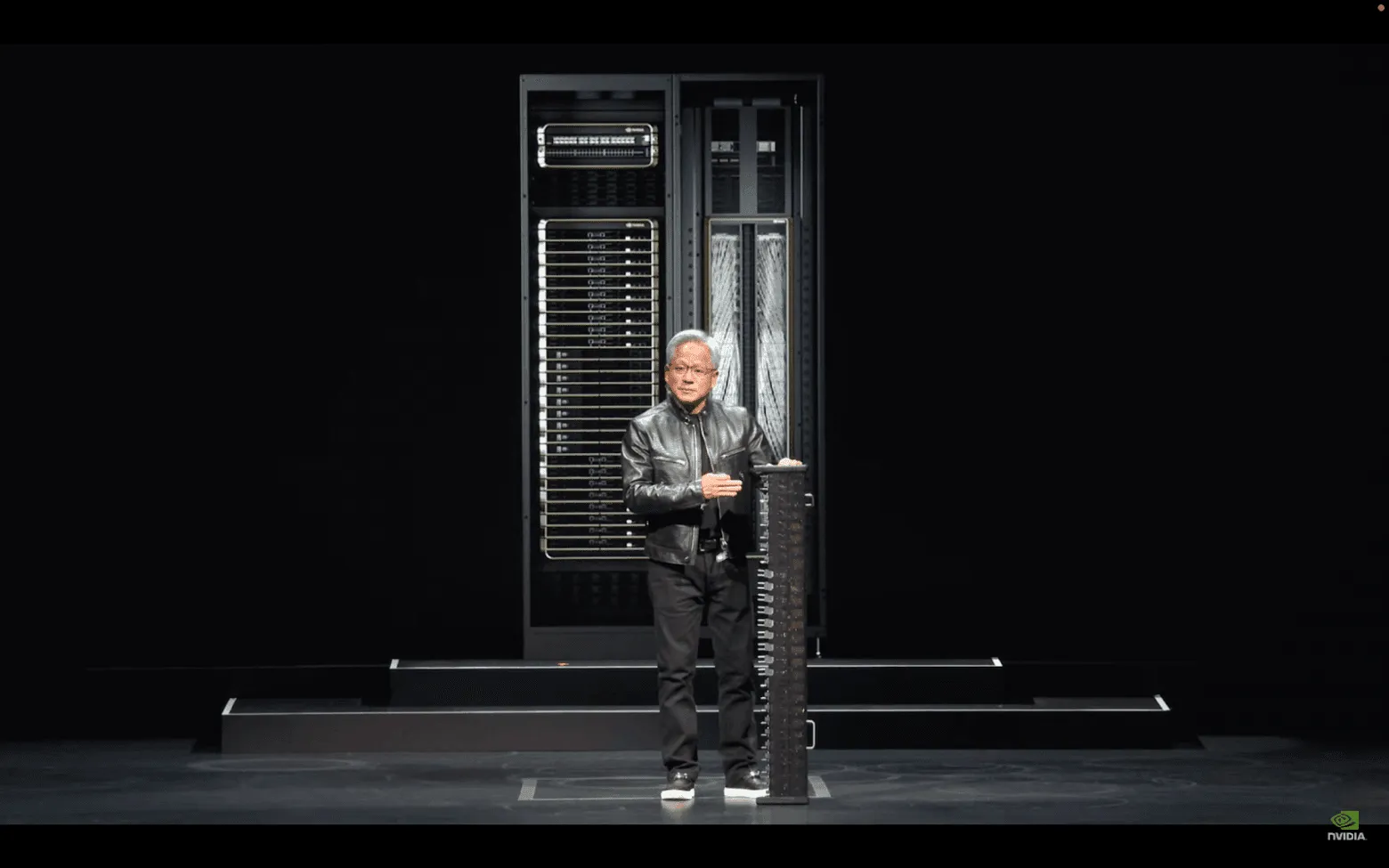

От такой энергии сервер очень сильно греется.

Обычное охлаждение не справляется, поэтому используют жидкостную систему. Уходит меньше энергии на охлаждение, выше плотность компонентов, обеспечивается стабильная работа под нагрузкой.

Это даёт несколько критических эффектов:

-

GPU обмениваются данными напрямую, без участия CPU.

-

Пропускная способность достигает сотен гигабайт в секунду на соединение.

-

Внутри системы формируется единое пространство памяти.

-

Синхронизация происходит почти без задержек.

В результате десятки GPU начинают работать как один вычислительный блок. Это важно, потому что современные модели нельзя просто «разрезать» на независимые части. Их компоненты постоянно зависят друг от друга, и без быстрой связи обучение либо замедляется в разы, либо становится экономически невыгодным.

Поэтому такие серверы — это не просто «очень мощные компьютеры». Это системы, в которых главное — не сила каждого GPU, а скорость, с которой они могут работать вместе.

Почему это стоит миллионы

Точнее, 3 млн долларов за один сервер (обычно их покупают десятками, соединяя в единый суперкомпьютер). И такая цена абсолютно оправданна. А ещё только на электричество один такой сервер будет тратить больше тысячи долларов в сутки.

GPU — основная статья расходов

Главная ценность системы — ускорители вроде Nvidia H100 или новых чипов поколения Blackwell. Это не видеокарты, а специализированные вычислительные блоки под нейросети:

-

Десятки тысяч вычислительных ядер.

-

От 80 до 192 ГБ памяти HBM прямо рядом с чипом.

-

Экстремальная пропускная способность внутри самого GPU.

Такие чипы стоят десятки тысяч долларов за штуку. В системе их 72 — и только на этом уровне счёт уже идёт на миллионы. Отдельно стоит упомянуть память HBM: она технологически сложнее обычной и сама по себе оказывается одной из самых дорогих частей каждого GPU. В сумме система получает несколько терабайт сверхбыстрой памяти, доступной почти как единое пространство.